InfiniCloud® AI

目的によって選ぶ導入方法

利用シーンや規模に応じて、いくつかの導入モデルを用意しています。

主な導入モデル、形態は次の3つです。

- オンプレミス導入用サブスクリプション

- データセンター・クラウド事業者向け OEM モデル(サブスクリプション)

- クラウド版(現在、さくらインターネット様にて提供中)

本ページでは、それぞれの導入形態と、GPU/VRAMに応じた推奨構成、モデルラインナップについて説明します。

導入形態

オンプレミスライセンスとサブスクリプション

国内 SIer・パートナー企業経由によるオンプレミス導入です。

- サーバーのハードウェアは SIer側でご提案・調達

- お客様のデータセンター・ラック内に設置され、完全に自社管理のネットワーク内で運用可能

- インストール・初期設定・基本的な運用設計については、パートナー SIer と連携しながら InfiniCloud が技術支援を行う

動作可能なモデルは、下記の、推奨動作環境のスペックを参照してください。

「どの GPU を選べばよいか分からない」「既に購入済みのサーバーで動かしたい」といったご相談は、提携するSIer、またはInfiniCloudまでお問い合わせください。

※現在、InfiniCloudでは、InfiniCloud AIを組み込んでシステム販売を行いたいシステムインテグレーターのパートナーを募集中です。詳しくはお問い合わせください。

参考≫ お知らせ一覧/【プレスリリース】高性能オンプレミスAI「InfiniCloud® AI」のOEM技術提供開始。データセンター事業者およびSIer向けに

OEM/ODM データセンター事業者向け専用モデル(サブスクリプション)

データセンター・クラウド事業者向けには、OEM 形態での提供が可能です。いずれも自社ブランド、あるいはInfiniCloudのブランド名にて、Private AIサービスを行うことが可能です。

- 自社データセンター内のGPU基盤に、InfiniCloud AIを用意したい場合

- 自社データセンターに、InfiniCloud AIに適合するGPU基盤を構築したい場合。

動作可能ハードウェアについては、下記の、推奨動作環境のスペックを参照してください。

参考≫ お知らせ一覧/【プレスリリース】高性能オンプレミスAI「InfiniCloud® AI」のOEM技術提供開始。データセンター事業者およびSIer向けに

クラウド版(準備中)

「まずはすぐに試してみたい」「サーバーの管理はしたくない」「閉域網で利用したい」「オンプレ導入前に PoC を行いたい」といったニーズ向けに、クラウド版 InfiniCloud AI も提供予定です。

- 初期投資無しで PoCから開始可能。

- 自社 SaaS のバックエンドとして LLMaaS 的に利用する用途にも適しています

現在、さくらインターネット様にてβ提供中です。

参考≫ お知らせ一覧/【プレスリリース】InfiniCloud、さくらインターネットとの協業により、AI基盤提供に向けた基本合意を締結。企業向けに外部に情報が漏洩しない閉域網に対応。

ライセンス、サブスクリプションモデル

InfiniCloud® AIのソフトウェアライセンスはApache 2ライセンスを基本としており、サブスクリプションは年間、あるいは月間でのGPU 単位のライセンスを基本としています。

- ホストへの搭載物理 GPU ではなく、「InfiniCloud AIに割り当てたGPU個数」でライセンス費用が変わります。

- 例:仮想化基盤のGPUパススルー機能を使い、8枚GPUを搭載したハードウェアに、GPUを「1枚」だけ見せた場合は、1ライセンスとなります。

- サブスクリプション価格はオープンプライスです。

- セキュリティパッチなどは、サブスクリプション版でのみ提供されます。

- 機能制限版向けのPoC向け特殊ライセンスもあります

導入規模、オンボーディングサポート内容に応じて SIer・OEM パートナーとの個別見積もりとなります。

現時点では、エンドユーザー向けに「ソフトウェア単体導入」はしておらず、SIer(販売パートナー) / OEM パートナー経由でのパッケージ提供をしております。

推奨動作環境のスペック(1500W未満で十分に動く動作環境)

InfiniCloud AIの推奨動作環境は、扱う LLM のパラメタ数や、どの目的、どの機能を使うかによって異なります。

ここでは、代表的な GPU と VRAM 構成ごとの 目安 を示します。

対応 GPU の例

フルスペック版

- NVIDIA

- H100 / H200 シリーズ

- B100 / B200 シリーズ

- RTX Pro 6000 Blackwell シリーズ

- AMD

- Instinct MI300X … 対応予定(準備が整い次第検証開始)

※ VRAM80GB以上が必要です。

機能限定版

- NVIDIA

- L40S/L4 シリーズ (※Fine Tune機能が利用できません)

※ 機能限定版動作には、VRAM 24GB以上が必要です。ただし、ファインチューン、VLMを用いた画像認識機能、音声認識機能が動作しません。また、同時利用ユーザ数が制限されます。

GPUの性能は、LLMの解答速度(tokens/sec)に影響します。

- GPU性能が高いと、解答速度が速い。

- GPU性能が高いと、並列的に回答しても、速度劣化が少ない。

- GPUのメモリ帯域が広いと、解答速度が速い。大きなモデルでも対応可能となる。

- LLMのパラメタ数が少ないと解答速度が速い。

- 複数のGPUを利用すると、その分解答速度も上がり、同時並列的な速度が上がる。

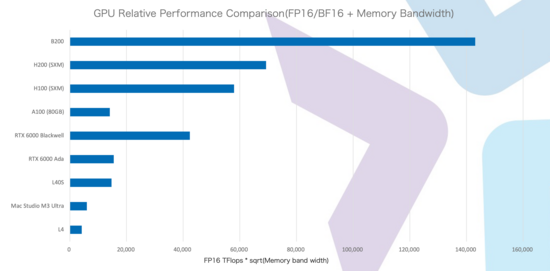

下記は、InfiniCloud AIにおけるベンチマークです。概ね、BF16でのTFlops(速度)x√メモリ帯域幅となっています。

これらの性能グラフは一例であり、当社の「InfiniCloud AI」を実行させるための環境は「このような傾向がある」と示したものです。

実際のサポート状況はバージョン・時期により変わるため、詳細は都度お問い合わせください。

VRAM サイズ別の機能レベル(ライティングモデルがパラメタ数20~30Bの場合)

以下は、パラメタ数が20〜30B クラスのライティングモデルを前提としたときの一例です(あくまで目安です)。

| VRAM 構成 | 推論のみ | FineTune | 同時セッション目安 | 想定シナリオ |

|---|---|---|---|---|

| 24〜48GB | ○ | × | VRAM 24GB:同時1セッション VRAM 48GB:同時2セッション。 ※同時利用4〜8人程度 | PoC。部内専用Private AI |

| 80GB~ | ○ | ○ | 同時4セッション前後 小〜中規模(〜数十人) | 本番運用可。 同時接続を増やし、ナレッジ増で余裕が減る。 夜間FineTuneなどが可能。 |

24〜48GB クラスでは、ベースモデル20Bパラメタ程度の推論自体は可能ですが、FineTune はできません。その他、VLMを用いた画像解析機能や、音声解析機能が無いため、InfiniCloud AIの「機能限定版」としての利用が中心となります。

80GB以上のクラス(H100 80GBや、RTX Pro 6000 Blackwell)では、20Bパラメタ程度のランゲージモデルの本番利用とLoRAベースの FineTune が可能ですが、大規模なナレッジ投入が必要な場合、VRAMが足りなくなることもあります。

VRAMは、並行セッション数xコンテキストトークンバッファ量(ユーザ質問などの長さ)に影響します。したがって1会話スレッドを小さく切って使う場合は、並列数を増やすことができます(config.iniにより設定が可能)。会話の深度が必要な場合は、並行セッション数を減らす必要があります。

同時セッション数を増やしたい場合

同時セッションを利用したい場合、VRAM 80GB以上あるGPUを1枚搭載したサーバを並列で利用することで処理が可能になります。

リクエストはロードバランサーなどで振り分けが必要になります。

一般にGPUのメモリ量は、パラメタ数の大きいランゲージモデル(LLM、VLMその他)を動作させたり、ファインチューン用メモリの余剰にも役立ち、並列性能にも貢献します。

大型LLMは高性能ですが、その分、メモリ専有量が多く、回答速度も遅くなります。また、ファインチューン時の勾配がつきにくい(ファインチューンによる学習効果が現れにくく、ベースモデルが持っている元の知識に回答が引っ張られやすい)傾向があります。

実際は、ニーズに合わせて、モデル種別やプロンプト長、ナレッジ量によって変動します。詳細なキャパシティ・プランニングについては個別にご相談ください。

CPUとメモリ、ストレージについて

メインメモリ:128GB以上。256GB以上を推奨します。同時セッション数に応じてメモリが必要となります。

CPU:AMD EPYC 3rdGen以降、Inten Xeon Skylake以降。GPUにランゲージモデルを全て乗せ切れない場合、CPUオフローディングを行います。この場合、CPUには一定の処理速度が必要となります。

ストレージ:512GB以上。1TB以上を推奨。登録する知能ドメインサイズ、アップロードするファイルサイズにより、必要なストレージサイズが異なります。